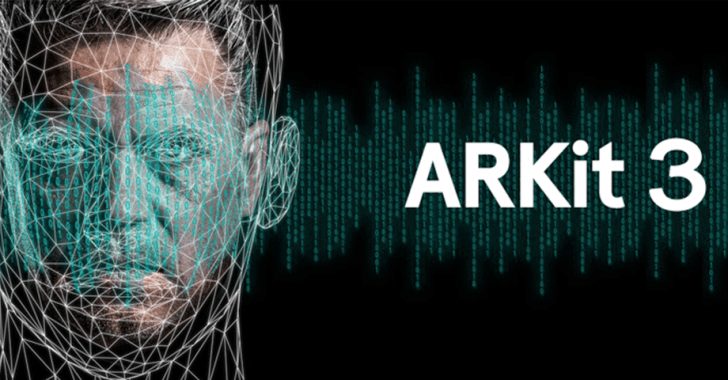

Augmented Reality

ARKit 2: Augmented Reality ist die Zukunft

14. März 2019

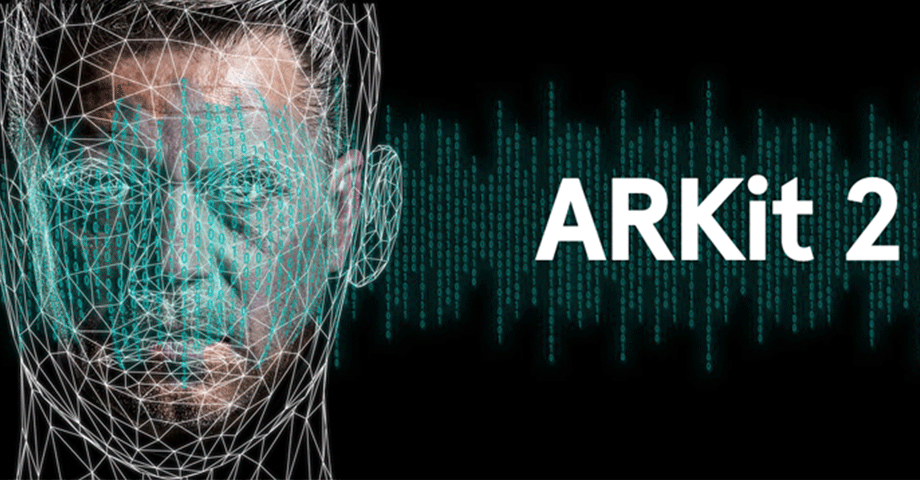

…sagt Apple und wir stimmen zu. ARKit 2 kann mithilfe der True Depth Kamera ein unglaublich genaues 3D Bild deines Gesichts erstellen. Das ist nur die Spitze des Eisbergs aus Möglichkeiten, die wir bestimmt bald noch sehen werden.

Wie alles begann

Angefangen hat eigentlich alles mit der Microsoft Kinect Kamera, einer der ersten kommerziellen Kameras mit eingebautem 3D Scanner. Der Großteil der Technologie, auf der die erste Version der Kinect aufbaute, stellte die israelischen Firma PrimeSense her. Diese Firma wurde vor 5 Jahren von Apple gekauft, woraufhin die Sensoren weiterentwickelt und immer weiter verkleinert wurden. Das Ergebnis ist nun eben, dass wir uns ein iPhone X mit eingebauter True Depth (Tiefensensor) Kamera kaufen können.

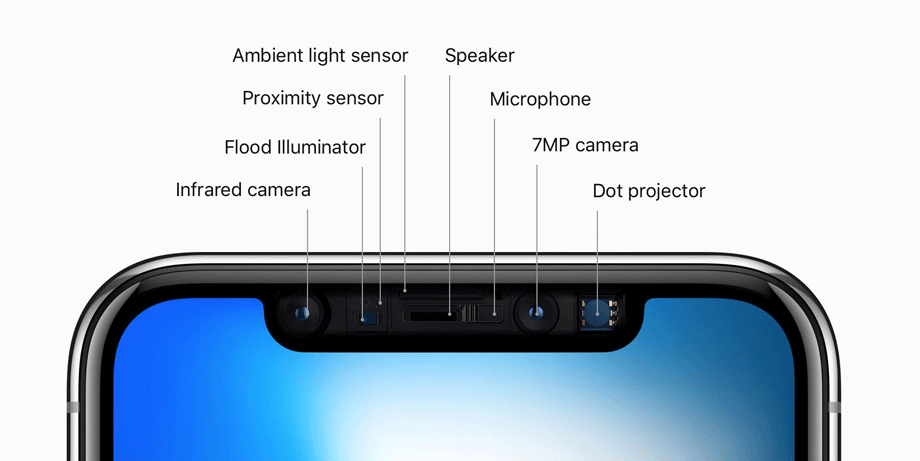

Im Gegensatz zur Dualkamera an der Hinterseite des iPhone X nutzt die True Depth Frontkamera eine gänzlich andere Technologie zur Erstellung von 3D-Bildern mit Tiefendaten. Anstatt zwei Fotos aus unterschiedlichen Perspektiven (und mit zwei Linsen) zu knipsen und diese anschließend mit Triangulationsalgorithmen zu bearbeiten, nutzt die Frontkamera eine einzige Linse in Verbindung mit einem Infrarotsensor um ein Tiefenbild des Gesichts zu erstellen. Zusätzlich werden dafür auch noch weitere Sensoren genutzt um beispielsweise die Leistung in dunklen Umgebungen zu verbessern. Diese Vorgehensweise ermöglicht eine viel detailreichere Darstellung, sodass z.B. Haare besser vom Hintergrund unterschieden werden können. Dadurch funktioniert FaceID in allen Umgebungen ziemlich gut.

Was bedeutet diese Technologie für uns Entwickler?

Vor der Veröffentlichung von ARKit 2 mussten Softwareentwickler sich intensiv mit Computer Vision Algorithmen beschäftigen (oder vorhandene Libraries anpassen bzw. umschreiben), nur um 2D Features aus menschlichen Gesichtern zu extrahieren. Dadurch erhielt man einen Algorithmus der, dafür dass er auf einem 2D Bild basierte, ganz okay funktionierte. Das Verpacken der auf diesem Weg extrahierten Daten in eine Anwendung nahm anschließend meist nur einen Bruchteil der Zeit in Anspruch.

ARKit 2 ist daher ein riesiger Schritt für die Welt der Mobilanwendungen, da wir quasi out-of-the-box mit 3 anstatt 2 Dimensionen arbeiten können. Wir haben nun Zugang zu den Tiefendaten jedes einzelnen Gesichtsbereichs und bekommen darüber hinaus ein Polygonnetz des gesamten erkannten Gesichts. Laien können sich ein solches Netz als perfekt auf das Gesicht angepasste virtuelle Maske vorstellen.

Wie ist das möglich?

Apple nutzt ein generisches Modell eines menschlichen Gesichts und ändert anschließend die markanten Stellen wie Augen, Nase, Wangen, Mund und Augenbrauen. Diese auf Basis der erkannten 3D Tiefendaten jedes individuellen Gesichts ab, um eine solche „personalisierte Maske“ zu generieren. Das wiederum macht es möglich, alle erdenklichen virtuellen Inhalte (Make-up, Tattoos, …) in genau auf dein eigenes Gesicht angepasster Form darzustellen und mitzubewegen. Außerdem wird damit eine viel genauere Analyse aller Gesichtsteile für weitere Anwendungen möglich.

Nun ist das zwar ziemlich nett, aber es braucht trotzdem noch ziemlich viel Zeit, ein AI zu erstellen, welches das 3D Polygonnetz eines Gesichtes erkennt und ein Animoji darauf abbildet. Es ist schwierig, die genaue Wangenposition festzustellen und noch schwieriger ist es zu wissen, wie sehr diese hochgezogen oder gedehnt sind.Aber siehe da, Apple hat auch dafür eine Lösung!

Die neue ARKit 2 API liefert uns eine unglaublich lange Liste an Gesichtsmerkmalen und Werten. Wie sehr ist beispielsweise der Mund gedehnt? Zeigen die Mundwinkel nach unten oder zeigt sich ein Lächeln? Bilden sich Grübchen, werden die Lippen zusammengepresst (auf beiden Seiten oder nur auf einer) oder zu einem Schmollmund geformt? Ich will jetzt wirklich nicht so klingen, als ob ich der nächste Speaker bei einer Apple WWDC (Anm: Apple’s jährliche Entwicklerkonferenz) Präsentation bin, aber das ist schon beeindruckend, oder nicht? Diese Funktionen erlauben es uns Entwicklern, uns hauptsächlich auf die Inhalte unserer Anwendungen zu fokussieren.

Wie geht es jetzt weiter?

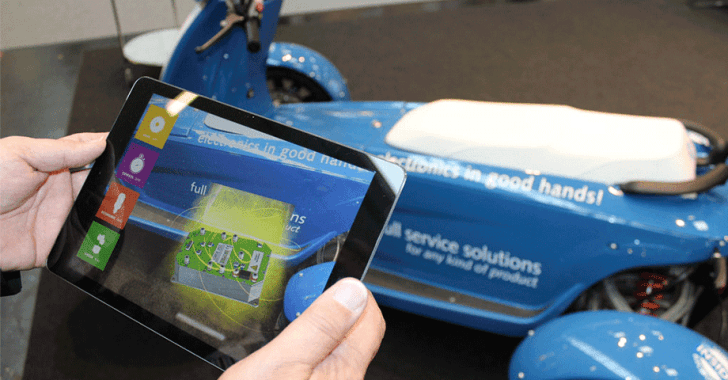

Meiner Meinung nach repräsentiert Augmented Reality eine glorreiche Zukunft für die Menschheit. Da man alle Vorzüge der virtuellen Welt genießen kann, ohne von der realen Welt abgeschirmt zu sein. Bei vielen anderen Technologien, wie z.B. VR, die Spieleindustrie und Social Media, ist genau das der Fall, was bei exzessiver Nutzung zu Problemen führen kann. Damit will ich nicht ausschließen, dass die künstliche Intelligenz dahinter – wie jede andere Technologie – in den falschen Händen auch missbraucht werden könnte (das kannst du z.B. auf diesen Artikel nachlesen), aber im Grunde ist Augmented Reality an sich eine Technologie mit unglaublichem Potential dafür, die Welt in vielen Bereichen zu vereinfachen und zu verbessern.